Fast zwei Drittel der Eltern unterstützen ihre erwachsenen Gen-Z-Kinder finanziell

Der Krieg im Iran endet nicht – er verwandelt sich in etwas Neues

Yelps KI-Chatbot kann jetzt Ihre Restaurantreservierung vornehmen

Humanoider Roboter bricht menschlichen Halbmarathon-Weltrekord in Peking.

EU weist Google an, Suchdaten mit Konkurrenten inklusive KI-Chatbots zu teilen

Krispy Kreme verschenkt gratis St. Patrick's Day Donuts fürs Grünetragen.

🔥JUST IN: Iran wants to charge tanker transit fees in Bitcoin, reports the Financial Times. It is demanding $1 in crypto for every barrel of oil passing through the Strait of Hormuz

This is the core issue with the current “peace process”: Israel cannot allow Iran to remain in its current form or future potential. An unsanctioned Iran earning massive revenue from resources, controlling the strait, with a large population and strong scientific base would

⚡️ Foreign Minister of Bahrain: Iran does not have the right to close the Strait of Hormuz Nice joke, Mister Minister

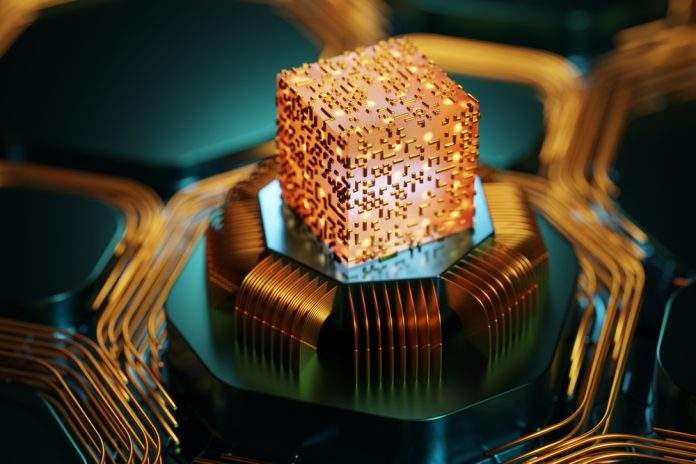

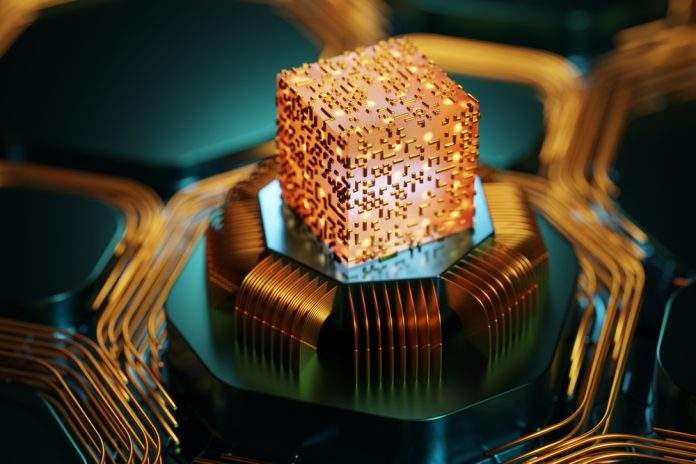

JUST IN: Google researchers indicate that quantum computers may be able to crack Bitcoin private keys in as little as 9 minutes

Iranian Foreign Minister Abbas Araghchi said that Iran is prepared to fight for at least 6 months. That timing would coincide with the US midterm elections. 6 months of war would guarantee victory for the Democratic Party, turn Trump into a lame duck, and effectively eliminate

That’s exactly how a war would break out between the U.S. and Israel on one side, and Iran on the other side

Iran exports more oil through the Strait of Hormuz than before the war began — WSJ. UAE, Qatar, Bahrain, Saudi Arabia - next time think with your heads, when deciding whether to host US military bases

🔥JUST IN: Iran wants to charge tanker transit fees in Bitcoin, reports the Financial Times. It is demanding $1 in crypto for every barrel of oil passing through the Strait of Hormuz

This is the core issue with the current “peace process”: Israel cannot allow Iran to remain in its current form or future potential. An unsanctioned Iran earning massive revenue from resources, controlling the strait, with a large population and strong scientific base would

⚡️ Foreign Minister of Bahrain: Iran does not have the right to close the Strait of Hormuz Nice joke, Mister Minister

JUST IN: Google researchers indicate that quantum computers may be able to crack Bitcoin private keys in as little as 9 minutes

Iranian Foreign Minister Abbas Araghchi said that Iran is prepared to fight for at least 6 months. That timing would coincide with the US midterm elections. 6 months of war would guarantee victory for the Democratic Party, turn Trump into a lame duck, and effectively eliminate

That’s exactly how a war would break out between the U.S. and Israel on one side, and Iran on the other side

Iran exports more oil through the Strait of Hormuz than before the war began — WSJ. UAE, Qatar, Bahrain, Saudi Arabia - next time think with your heads, when deciding whether to host US military bases